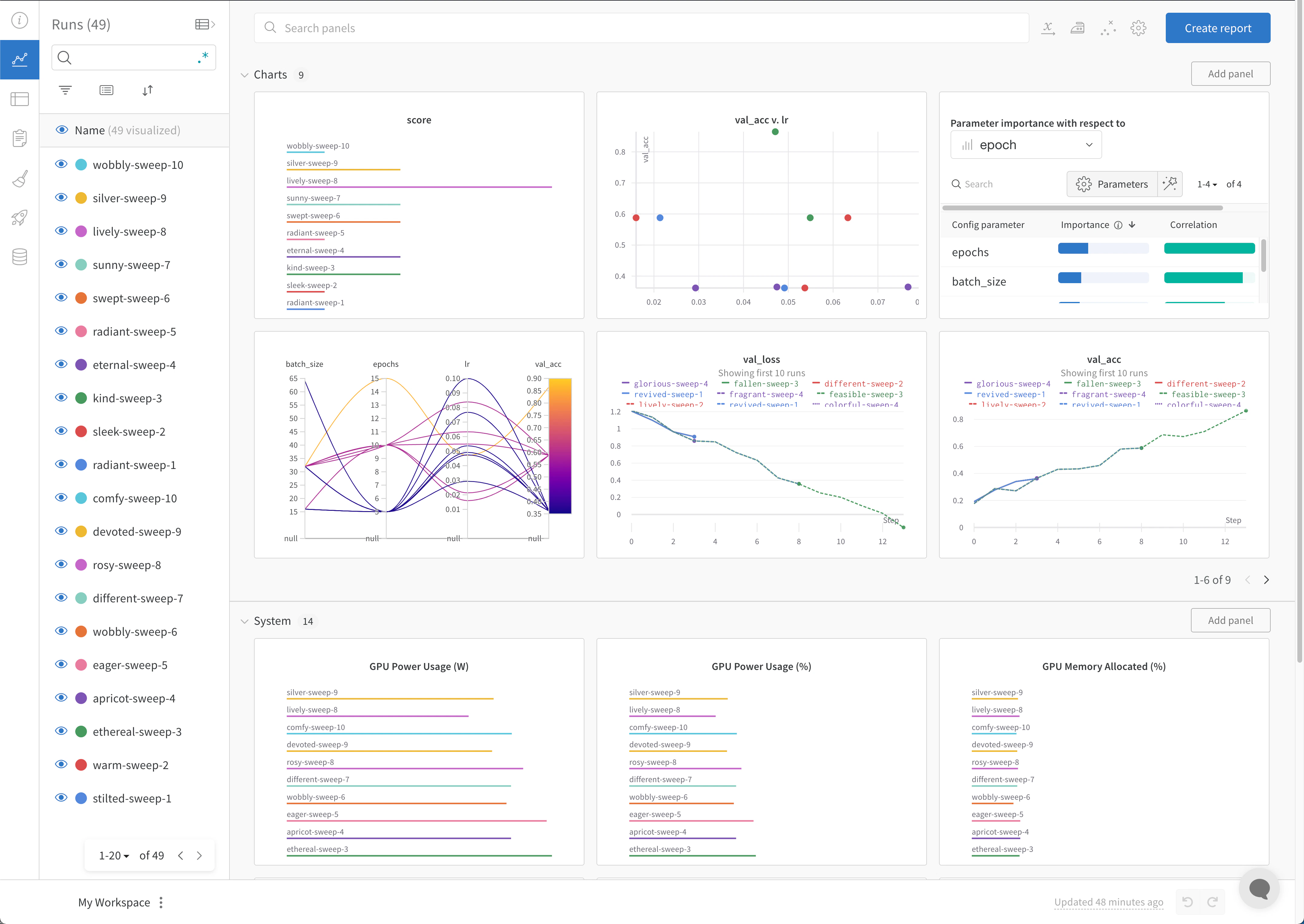

W&B Python SDK を使用して、機械学習の実験をトラッキングできます。結果はインタラクティブなダッシュボードで確認できるほか、W&B Public API を使用してプログラムからアクセスできるよう、データを Python にエクスポートすることもできます。 このガイドでは、W&B の構成要素を使用して W&B Experiment を作成する方法を説明します。Documentation Index

Fetch the complete documentation index at: https://wb-21fd5541-john-wbdocs-2044-rename-serverless-products.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

W&B Experiment の作成方法

W&B run を初期化する

wandb.init() を使用します。

次のスニペットは、“cat-classification” という名前の W&B プロジェクトに run を作成し、この run を識別しやすくするために説明として “My first experiment” を設定しています。さらに、“baseline” と “paper1” のタグを追加して、この run が将来の論文公開を想定したベースライン実験であることがわかるようにしています。

wandb.init() は Run オブジェクトを返します。

注:

wandb.init() を呼び出した時点ですでにそのプロジェクトが存在する場合、Runs は既存のプロジェクトに追加されます。たとえば、“cat-classification” という名前のプロジェクトがすでにある場合、そのプロジェクトは削除されず、引き続き存在します。代わりに、そのプロジェクトに新しい run が追加されます。ハイパーパラメーターの辞書を記録する

config に記録したモデルの設定は、後で結果を整理したりクエリしたりするのに役立ちます。

トレーニングループ内でメトリクスをログする

run.log() を呼び出します。

Artifact を W&B にログする

以上をまとめると

次のステップ: 実験を可視化する

ベストプラクティス

- run を終了する:

with文でwandb.init()を使用すると、コードの実行が完了したとき、または例外が発生したときに、run が自動的に終了済みとしてマークされます。-

Jupyter ノートブックでは、Run オブジェクトを自分で管理したほうが便利な場合があります。この場合は、Run オブジェクトで

finish()を明示的に呼び出して、完了としてマークできます。

-

Jupyter ノートブックでは、Run オブジェクトを自分で管理したほうが便利な場合があります。この場合は、Run オブジェクトで

- Config: モデルを再現するために使用したいハイパーパラメーター、アーキテクチャ、データセット、そのほかの情報をトラッキングします。これらは column として表示され、アプリでは設定 column を使って run を動的にグループ化、並べ替え、フィルターできます。

- Project: プロジェクトは、まとめて比較できる Experiments の集合です。各プロジェクトには専用のダッシュボードページがあり、異なるモデル バージョンを比較できるように、run のさまざまなグループを簡単にオン/オフできます。

- Notes: スクリプトから直接、簡単なコミットメッセージを設定します。メモは W&B App の run の Overview セクションで編集および確認できます。

- Tags: ベースラインの run や重要な run を識別します。tags を使って run をフィルターできます。tags は、後から W&B App のプロジェクトのダッシュボードにある Overview セクションで編集できます。

- Experiments を比較するために複数の run set を作成する: Experiments を比較するときは、メトリクスを比較しやすくするために複数の run set を作成します。同じ チャート または チャート のグループ上で、run set のオン/オフを切り替えられます。

wandb.init() API ドキュメントを参照してください。