W&B의 모델 artifact를 NVIDIA NeMo Inference Microservice에 배포합니다. 이를 위해 W&B Launch를 사용합니다. W&B Launch는 모델 artifact를 NVIDIA NeMo Model로 변환한 뒤, 실행 중인 NIM/Triton 서버에 배포합니다. 현재 W&B Launch는 다음 호환 모델 유형을 지원합니다:Documentation Index

Fetch the complete documentation index at: https://wb-21fd5541-john-wbdocs-2044-rename-serverless-products.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

배포 시간은 모델과 머신 유형에 따라 달라집니다. 기본 Llama2-7b 설정은 Google Cloud의

a2-ultragpu-1g에서 약 1분 정도 걸립니다.퀵스타트

-

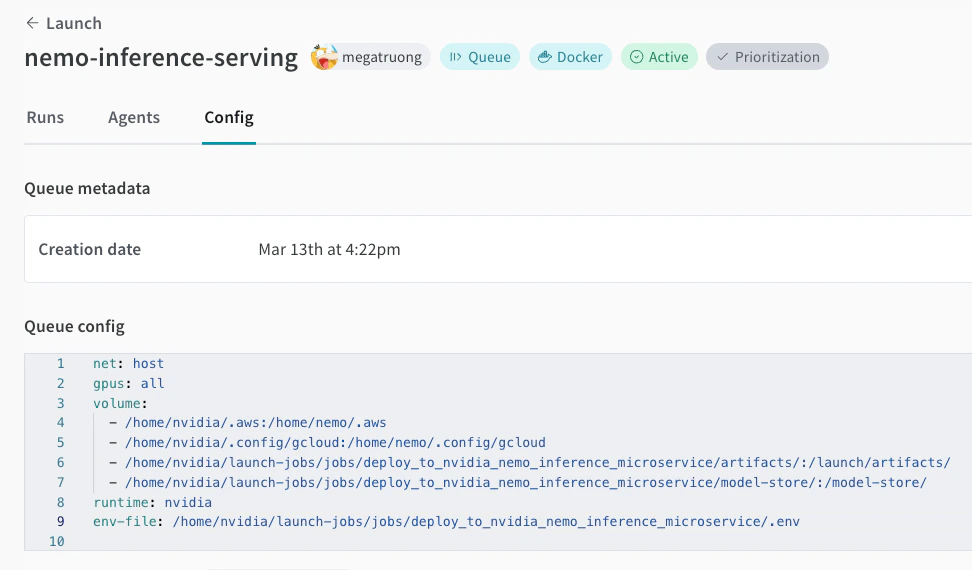

아직 없다면 Launch 큐를 생성하세요. 아래에 예시 큐 설정이 나와 있습니다.

-

프로젝트에 이 작업을 생성합니다:

-

GPU 머신에서 agent를 실행합니다:

-

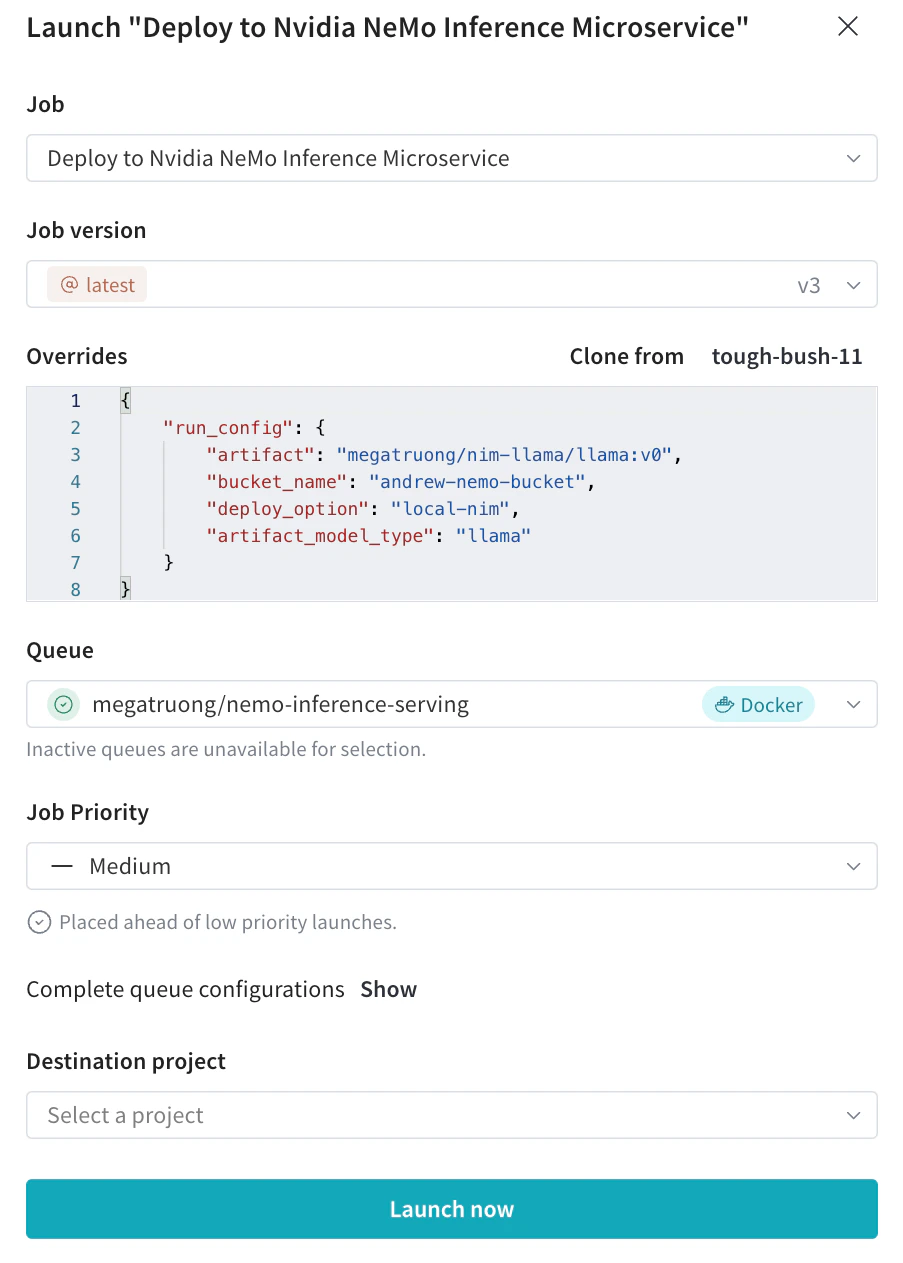

Launch UI에서 원하는 설정으로 배포 launch 작업을 제출합니다.

- CLI를 통해서도 제출할 수 있습니다:

- CLI를 통해서도 제출할 수 있습니다:

-

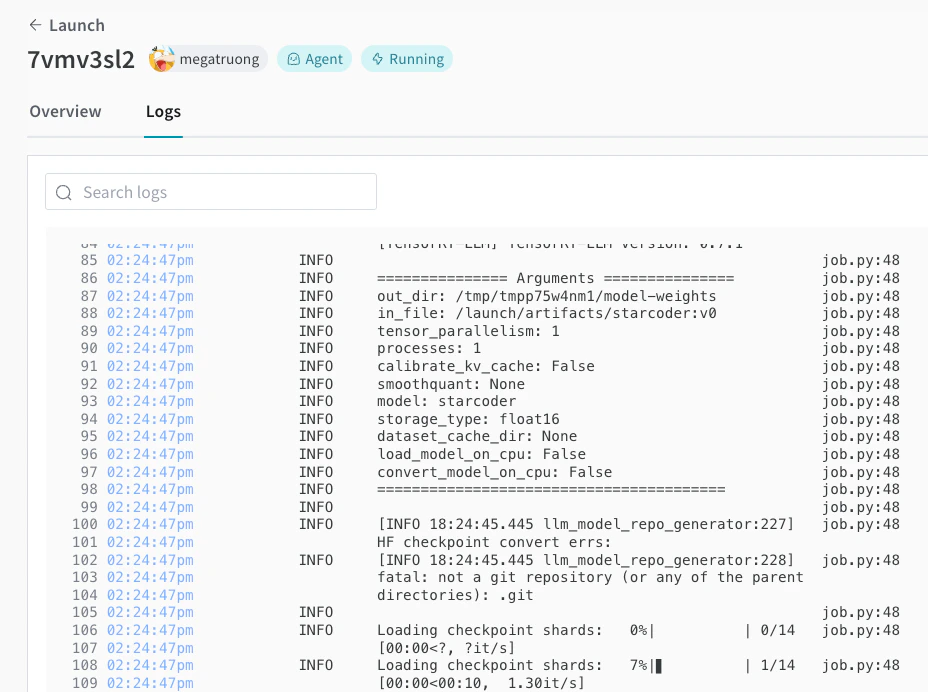

Launch UI에서 배포 진행 상태를 추적할 수 있습니다.

-

완료되면 바로 엔드포인트에

curl요청을 보내 모델을 테스트할 수 있습니다. 모델 이름은 항상ensemble입니다.