Documentation Index

Fetch the complete documentation index at: https://wb-21fd5541-john-wbdocs-2044-rename-serverless-products.mintlify.app/llms.txt

Use this file to discover all available pages before exploring further.

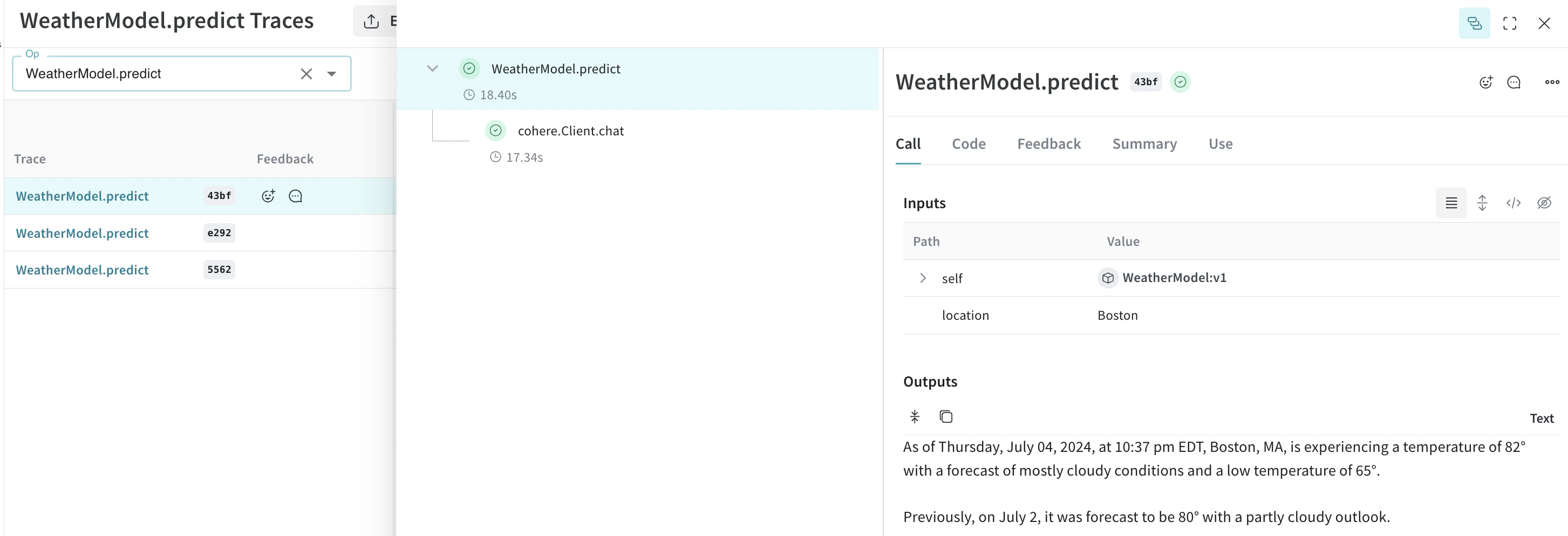

weave.init() の呼び出し後、Weave は Cohere Python ライブラリ 経由で行われる LLM call を自動的にトラッキングしてログします。

トレース

weave.init() を呼び出します:

weave.init() の呼び出し時に W&B team を指定しない場合は、デフォルトの entity が使用されます。デフォルトの entity を確認または更新するには、W&B Models ドキュメントの User Settings を参照してください。

Cohere モデルの強力な機能の 1 つに、connectors を使って、エンドポイント側から他の API へリクエストを送信できることがあります。レスポンスには、コネクタ から返されたドキュメントへのリンクを含む citation 要素付きの生成テキストが含まれます。

LLM Call をトラッキングできるように、Cohere の

Client.chat()、AsyncClient.chat()、Client.chat_stream()、AsyncClient.chat_stream() の各 method にはこちらでパッチを適用しています。独自の op でラップする

@weave.op() でデコレートした関数を作成するだけで、Weave が入力と出力をトラッキングしてくれます。以下はその例です。

実験をしやすくするために Model を作成する

Model クラスを使用すると、system prompt や使用しているモデルなど、アプリの実験に関する詳細を記録して整理できます。これにより、アプリのさまざまなバージョンを整理し、比較しやすくなります。

Model は、コードのバージョン管理や入力/出力の記録に加えて、アプリケーションの挙動を制御する構造化されたパラメーターも保持するため、どのパラメーターが最も効果的だったかを簡単に見つけられます。また、Weave Models は serve や Evaluation でも使用できます。

以下の例では、model と temperature を試せます。これらのいずれかを変更するたびに、WeatherModel の新しい version が作成されます。